Le droit est « l'ensemble des règles qui régissent la conduite de l'homme en société, les rapports sociaux. », ou de façon plus complète, « l'ensemble des règles imposées aux membres d'une société pour que leurs rapports sociaux échappent à l'arbitraire et à la violence des individus et soient conformes à l'éthique dominante »

Définition Wikipedia

Définition Wikipedia

Livres classés droit (5702)

Global Mobility - Managing the Tax and the Legal Risks and Opportunities

Alexandre De Munck

5.00★ (1)

Le droit de l'art en question: 20 réponses juridiques sur des thématiques artistiques

Charles Colomar

5.00★ (1)

Déclaration des droits de la femme et de la citoyenne de Olympe de Gouges

Olympe de Gouges

3.30★ (60)

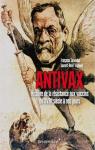

Antivax : Histoire de la résistance aux vaccins du XVIIIe siècle à nos jours

Françoise Salvadori

4.25★ (31)

Jusqu'au bout de mes peines : Chronique d'un juge de l'application des peines

Bérangère Le Boedec-Maurel

4.21★ (24)

Ajoutez une étiquette en cliquant ci-dessous

Ou recherchez une étiquette

Droit des Femmes

LaetiF

52 livres

Quiz

Voir plus

Les mystères de l'Histoire

En quelle année est mort Socrate?

En -390

En -366

En -344

En -399

41 questions

42 lecteurs ont répondu

Thèmes :

histoire

, politique

, droit

, justice

, personnages

, mystère

, complots

, philosophe

, divinités

, affaires

, art

, peinture

, inspiration

, littératureCréer un quiz sur cette thématique42 lecteurs ont répondu

Découvrez des thématiques proches

Les Dernières Actualités

Voir plus